AI-drivna detektorer är de bästa verktygen för att upptäcka AI-genererade falska videor. Washington Post via Getty Images

En undersökande journalist får en video från en anonym vissare. Det visar en kandidat för president som erkänner olaglig verksamhet. Men är den här videon riktig? Om så är fallet skulle det vara enorma nyheter - livets skopa - och helt kunna vända det kommande valet. Men journalisten kör videon genom ett specialiserat verktyg som berättar för henne att videon inte är som den verkar. Det är faktiskt ett ”deepfake, ”En video gjord med artificiell intelligens med djupt lärande.

Journalister över hela världen kan snart använda ett sådant verktyg. På några år kan ett sådant verktyg till och med användas av alla för att utrota falskt innehåll i sina sociala medier.

As forskare som har studerat djupfalsdetektering och utveckla ett verktyg för journalister ser vi en framtid för dessa verktyg. De kommer dock inte att lösa alla våra problem, och de kommer bara att vara en del av arsenalen i den bredare kampen mot desinformation.

Problemet med deepfakes

De flesta vet att du inte kan tro på allt du ser. Under de senaste decennierna har smarta nyhetskonsumenter vant sig vid att se bilder manipuleras med fotoredigeringsprogram. Videor är dock en annan historia. Hollywood-regissörer kan spendera miljontals dollar på specialeffekter för att skapa en realistisk scen. Men genom att använda deepfakes kan amatörer med några tusen dollar datorutrustning och några veckor att spendera göra något nästan lika riktigt mot livet.

Deepfakes gör det möjligt att placera människor i filmscener som de aldrig var med i - tror Tom Cruise spelar Iron Man - vilket ger underhållande videor. Tyvärr gör det också möjligt att skapa pornografi utan samtycke av folket som avbildas. Hittills är dessa människor, nästan alla kvinnor, de största offren när deepfake-teknik missbrukas.

Deepfakes kan också användas för att skapa videor av politiska ledare som säger saker som de aldrig sa. Det belgiska socialistpartiet släppte en icke-förfalskad men fortfarande falsk video av låg kvalitet President Trump förolämpar Belgien, som fick nog av en reaktion för att visa de potentiella riskerna med djupfakes av högre kvalitet.

{vembed Y=poSd2CyDpyA}

University of California, Berkeleys Hany Farid förklarar hur djupa förfalskningar görs.

Kanske det läskigaste av allt, de kan användas för att skapa tvivel om innehållet i riktiga videor, genom att föreslå att de kan vara djupa förfalskningar.

Med tanke på dessa risker skulle det vara oerhört värdefullt att kunna upptäcka djupa förfalskningar och märka dem tydligt. Detta skulle säkerställa att falska videor inte lurar allmänheten och att riktiga videor kan tas emot som äkta.

Spotting förfalskningar

Deepfake-upptäckt som forskningsfält började lite över tre år sedan. Tidigt arbete fokuserade på att upptäcka synliga problem i videorna, till exempel djupa förfalskningar som inte blinkade. Med tiden dock förfalskningar har blivit bättre att efterlikna riktiga videor och bli svårare att upptäcka för både människor och detektionsverktyg.

Det finns två huvudkategorier av forskning om djupfalsdetektering. Det första handlar om tittar på människors beteende i videorna. Anta att du har mycket video av någon känd, som president Obama. Artificiell intelligens kan använda den här videon för att lära sig hans mönster, från hans handgester till hans pauser i tal. Det kan då titta på en djupfake av honom och märker var det inte matchar dessa mönster. Detta tillvägagångssätt har fördelen att det kanske fungerar även om videokvaliteten i sig är perfekt.

{vembed Y=gsv1OsCEad0}

SRI Internationals Aaron Lawson beskriver ett tillvägagångssätt för att upptäcka deepfakes.

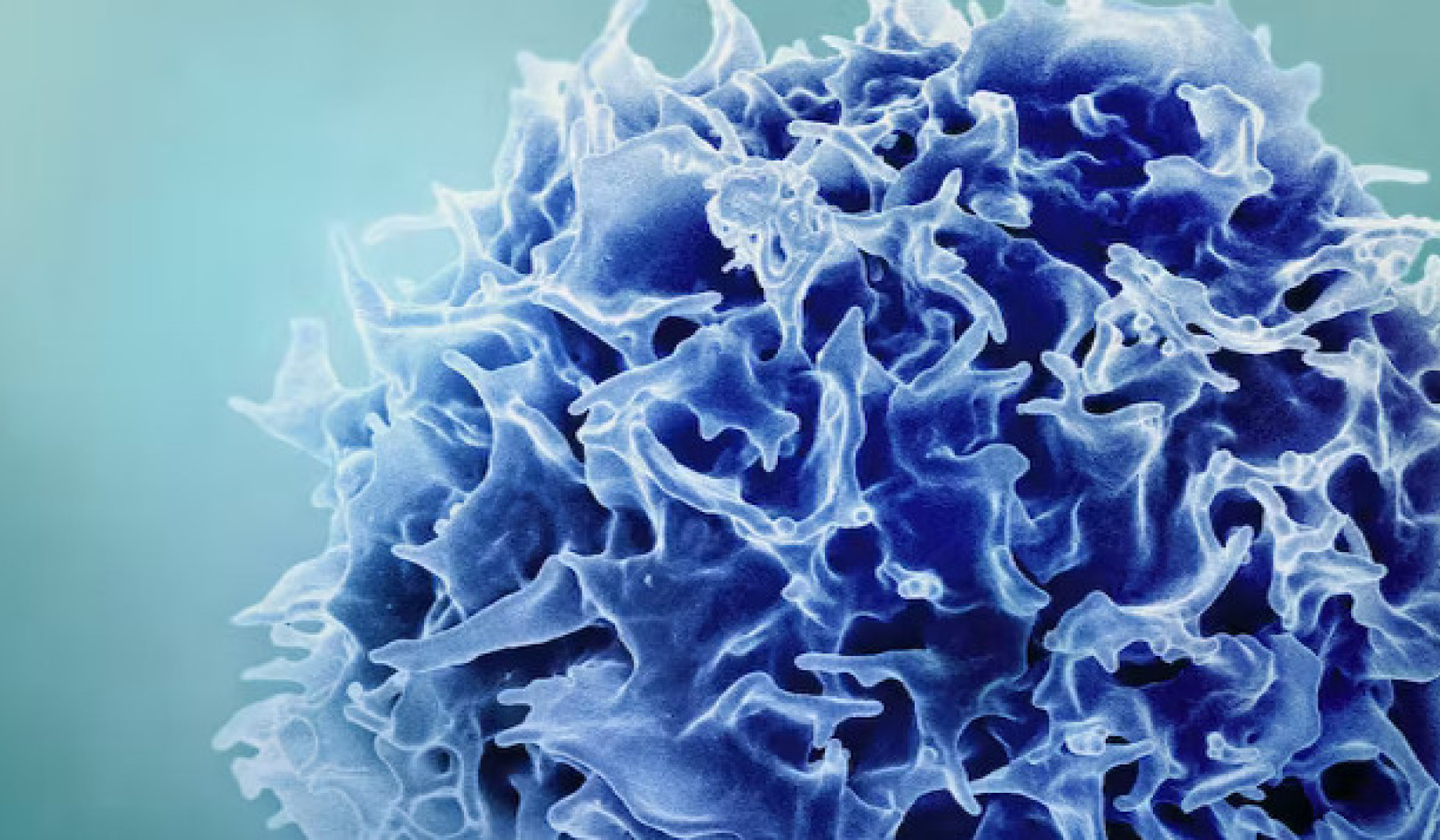

Andra forskare, inklusive vårt team, har fokuserats på skillnader den där alla deepfakes har jämfört med riktiga videor. Deepfake-videor skapas ofta genom att slå samman individuellt genererade ramar för att bilda videor. Med hänsyn till detta extraherar vårt teams metoder viktiga data från ansikten i enskilda bildrutor i en video och spårar dem sedan genom uppsättningar av samtidiga bildrutor. Detta gör att vi kan upptäcka inkonsekvenser i informationsflödet från en ram till en annan. Vi använder en liknande metod för vårt falska ljuddetekteringssystem också.

Dessa subtila detaljer är svåra för människor att se, men visar hur djupa förfalskningar inte är riktigt perfekt ännu. Detektorer som dessa kan fungera för alla människor, inte bara för några få världsledare. I slutändan kan det vara så att båda typerna av djupfalsdetektorer kommer att behövas.

Senaste upptäckssystem fungerar mycket bra på videor som är specifikt samlade för att utvärdera verktygen. Tyvärr gör även de bästa modellerna det dåligt på videor som hittades online. Att förbättra dessa verktyg för att vara mer robusta och användbara är nästa steg.

Vem ska använda deepfake-detektorer?

Helst bör ett djupfalsverifieringsverktyg vara tillgängligt för alla. Denna teknik befinner sig dock i de tidiga utvecklingsstadierna. Forskare måste förbättra verktygen och skydda dem mot hackare innan de släpps i stort.

Men samtidigt är verktygen för att göra djupa förfalskningar tillgängliga för alla som vill lura allmänheten. Att sitta på sidan är inte ett alternativ. För vårt team var rätt balans att arbeta med journalister, för de är den första försvarslinjen mot spridning av felinformation.

Innan journalister publicerar berättelser måste de verifiera informationen. De har redan beprövade metoder, som att kolla med källor och få mer än en person att verifiera viktiga fakta. Så genom att lägga verktyget i deras händer ger vi dem mer information, och vi vet att de inte kommer att förlita sig på tekniken ensam, med tanke på att den kan göra misstag.

Kan detektorerna vinna vapenloppet?

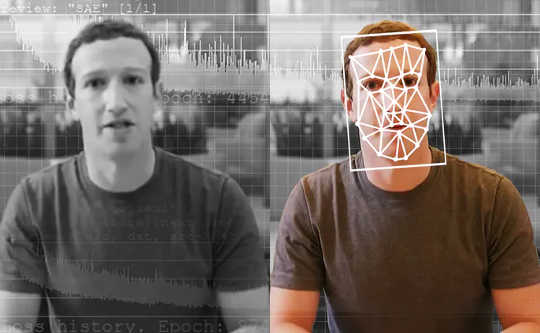

Det är uppmuntrande att se lag från Facebook och Microsoft investera i teknik för att förstå och upptäcka djupa förfalskningar. Detta område behöver mer forskning för att hålla jämna steg med framstegen inom djupfake-teknik.

Journalister och sociala medieplattformar måste också ta reda på hur man bäst kan varna människor för djupa förfalskningar när de upptäcks. Forskning har visat att folk kommer ihåg lögnen, men inte det faktum att det var en lögn. Kommer detsamma att gälla för falska videor? Att bara sätta "Deepfake" i titeln kanske inte räcker för att motverka vissa typer av desinformation.

Deepfakes är här för att stanna. Att hantera desinformation och skydda allmänheten blir mer utmanande än någonsin när artificiell intelligens blir mer kraftfull. Vi är en del av ett växande forskarsamhälle som tar på sig detta hot, där upptäckt bara är det första steget.![]()

Om författarna

John Sohrawardi, doktorand i datavetenskap, Rochester Institute of Technology och Matthew Wright, professor i datasäkerhet, Rochester Institute of Technology

Denna artikel publiceras från Avlyssningen under en Creative Commons licens. Läs ursprungliga Artikeln.